Lehetséges okok, ami miatt a Google nem indexeli a weboldalunkat | Weboptim

Ahhoz, hogy weboldalunk az organikus keresési eredmények között megjelenjen, a Google-nek indexelni kell az adott site-ot. Ha ez nem történik meg, akkor a holnap elveszik – senki nem talál rá.

Éppen ezért fontos megvizsgálni, hogy az oldalunk nem-e tartalmaz bármi olyan elemet, ami miatt a Google indexelés nem működik.

Nézzük meg, mik lehetnek a leggyakoribb okok:

1. ‘www.’ vs. ‘www nélküli’ verzió esete

Technikailag a ‘www’ verzió egy aldomaint jelent. Tehát a tesco.hu és a www.tesco.hu nem ugyanaz az oldal, még ha nem is látunk köztük különbséget.

Annak érdekében, hogy meggyőződjünk arról, hogy a Google mindkettőt helyesen indexelni, vegyük fel mindkét weboldalt a Google Webmestereszközökben. Állítsuk be, hogy melyik legyen a preferált domain.

2. A Google még nem találta meg az oldalt

Gyakori probléma lehet új weboldalak esetében. Várjunk néhány napot, de ha azt tapasztaljuk, hogy a Google még mindig nem indexeli, győződjünk meg róla, hogy az oldaltérképet feltöltöttük és megfelelően működik. Ha nem készítettük ilyen oldaltérképet, akkor lehet, hogy ez a probléma.

Egyéb lehetőségként meg is kérhetjük a Google-t, hogy térképezze fel az oldalunkat. Ennek lépéseit megtalálhatjuk a Google support részében.

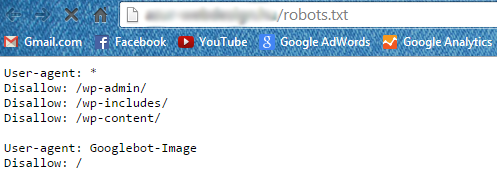

3. Az oldalt blokkolja a robots.txt

A robots.txt a webhelyek root könyvtárában található fájl; funkciója, hogy szabályozza, hogy a keresőmotorok milyen információkhoz férhetnek hozzá a weboldalon.

Formátuma meghatározott, 2 sort mindig tartalmaz:

- User-Agent: itt kell megadni a robot nevét, pl.: Googlebot (ha *-ot látunk, akkor a fájl minden robotra vonatkozik)

- Disallow: itt pedig azt, hogy miket szeretnénk kizárni az indexelésből pl.: /images/

Gyakori hiba, hogy a fejlesztő vagy szerkesztő a robots.txt használatával blokkolja az oldalt.

Ezt egyszerű megszüntetni, csak töröljük ki a robots.txt fájlt.

4. Az oldal nem tartalmaz sitemap.xml fájlt

A sitemap a weboldalunk oldalait tartalmazó lista, ami segíti a Google-nek és más keresőmotoroknak a webhelytartalom megértését. A Google követni tudja az oldal indexelésekor is.

A következő esetekben lehet nagyon hasznos a használata:

- a weboldalunk túl nagy – a keresőmotor nehezen tudná átlátni

- sok archivált tartalmunk van, vagy a tartalmak nincsenek összekötve egymással

- a weboldalunk új, és ezért még kevés külső linket tartalmaz

- sok média tartalmunk van (kép, videó, Google News)

Még ha a fentiek közül egyik sem jellemző a weboldalunkra, akkor is érdemes lehet feltölteni, hogy segítsük a Google-t. Elkészítése egyszerű feladat, akár online is elvégezhetjük.

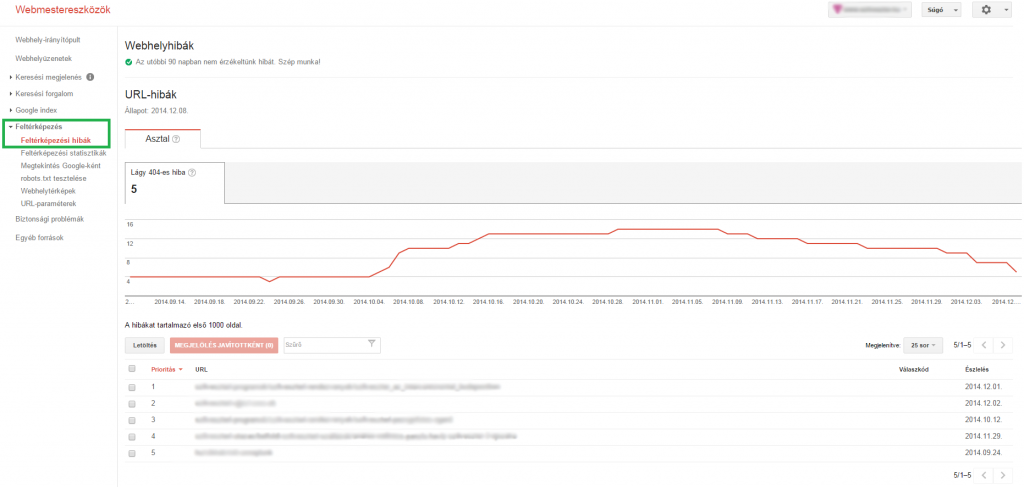

5. Feltérképezési hibák vannak

Néhány esetben a Google azért nem indexel egyes aloldalakat, mert látja ugyan, de nem tudja feltérképezni őket valami miatt. Az ilyen oldalak listáját megtalálhatjuk a Google Webmestereszközök Feltérképezési hibák nevű részében.

6. Sok a duplikált tartalom

Az számít duplikált tartalomnak, ha több különböző oldal (URL) teljesen ugyanazt a tartalmat adja. A túl sok ismétlődő tartalom összezavarhatja a keresőmotorokat, akik emiatt abbahagyják az indexelést. A probléma egyszerűen megoldható 301-es átirányítás segítségével. Használhatunk canonical tag-et is, de az valamivel bonyolultabb megoldás.

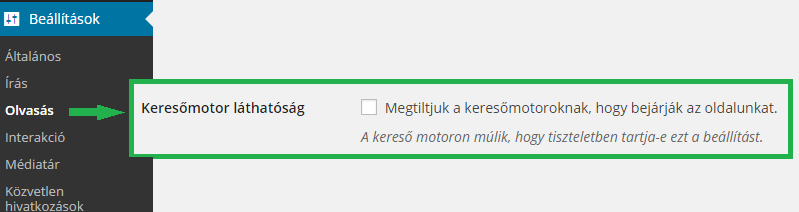

7. Az adatvédelmi beállítások be vannak kapcsolva

Ha WordPress weboldalt üzemeltetünk, akkor nézzük meg az adatvédelmi beállításokat. Előfordulhat, hogy bekapcsoltunk egy olyan funkciót, ami akadályozza az indexelést.

8. Az oldalt blokkolja a .htaccess fájl

A .htaccess fájt a weboldal szerves része, a szerveren található. Lehetővé teszi, hogy az oldal elérhető legyen a világhálón. Bár alkalmazása praktikus és hasznos, könnyen blokkolhatjuk vele a robotokat, ami megakadályozza az indexelést.

9. Ajax/Javascript problémák

A Google indexeli a JavaScript és Ajax fájlokat is, de ezeket nem tudja olyan egyszerűen feltérképezni, mint a HTML adatokat. Ezért ha helytelenül konfiguráljuk az ilyen típusú oldalakat, a keresőmotorok nem fogják tudni indexelni.

10. Lassú oldalbetöltési idő

A Google nem preferálja, ha a weboldalunk betöltési ideje nagyon hosszú. Ha a robotok úgy érzékelik, hogy végeláthatatlan ideig tölt az oldal, akkor nagy valószínűséggel nem fogják indexelni.

11. Hosting akadályok

Ha a robot nem tud hozzáférni az oldalhoz, akkor nem tudja indexelni sem.

Mikor történhet meg ez?

Ha a hosztnál gyakori a kimaradás, megtörténhet, hogy a robotok nem jutnak el az oldalra. Ellenőrizzük a kapcsolódásokat.

12. Deindex állapot

Ha a weboldalnak kétes múltja van, előfordulhat, hogy egy lappangó büntetés megakadályozza az feltérképezést. Akinek a honlapja már szendevett el büntetést és emiatt eltávolították az indexelésből, nagyon nehéz munka árán tud csak visszakerülni.

Összefoglalás

SEO szempontjából az indexelés kulcsfontosságú tényező. Ha a weboldalunk vagy annak egy része nincsen feltérképezve, mindenképpen nézzük utána, hogy miért lehet.

Forrás: searchenginejournal.com